Zarah Ziadi

1. April 2026

Wenn Bilder nicht mehr die Wahrheit sprechen

Künstliche Intelligenz macht es heute einfacher denn je, täuschend echte Bilder, Videos und Audioinhalte zu erzeugen – und erschwert damit die Unterscheidung zwischen Realität und Manipulation. Die Non-Profit-Organisation WITNESS arbeitet seit über 30 Jahren an der Schnittstelle von Menschenrechten und audiovisuellen Medien. Sie unterstützt Aktivist*innen, Journalist*innen und Communitys dabei, Übergriffe zu dokumentieren und mit Risiken wie Desinformation umzugehen.

Diese Arbeit ist heute dringlicher denn je: KI-generierte Inhalte und andere Formen der Manipulation können Vertrauen gezielt untergraben, besonders in sensiblen Kontexten. Gleichzeitig geht es darum, manipulierte Inhalte zu erkennen und die Glaubwürdigkeit authentischer Medien zu sichern. Auch für Plattformen wie Wikipedia, Wikidata oder Wikimedia Commons ist das entscheidend. Ihre frei zugänglichen Medien belegen und veranschaulichen Wissen – umso wichtiger ist es, Herkunft und Kontext einschätzen zu können.

Im folgenden Interview gibt shirin anlen, AI Research Technologist und Impact Managerin bei WITNESS, Einblicke in die Herausforderungen KI-generierter Medien, zeigt Strategien zur Verifikation auf und erklärt, wie sich vertrauenswürdige audiovisuelle Belege schützen lassen.

Takeaways

- Echtes und gefälschtes Material lassen sich immer schwerer unterscheiden: KI kann täuschend echte Bilder, Videos und Tonaufnahmen erzeugen – dadurch werden echte Inhalte ebenfalls in Zweifel gezogen. In diesem Zusammenhang spricht man auch von der „Liar’s Dividend”.

- Einfache Manipulationen sind am häufigsten: Falsche Beschriftungen, verkürzte Inhalte oder ein neuer Kontext können die Aussage eines Mediums massiv verändern – aufwändige Deepfakes sind dafür meist gar nicht nötig.

- Verlässliche Inhalte sichern durch Kontext und Zusammenarbeit: Es hilft, die Originaldateien aufzubewahren, Zeitpunkt, Ort und die Situation der Aufnahme zu dokumentieren, um im Zweifel die Authentizität eines Beitrags belegen zu können. In Communitys lässt sich Material gemeinsam noch leichter überprüfen oder schneller als Fake erkennen.

- Überprüfen statt überwältigt sein: Methoden wie SIFT helfen: innehalten, Quelle prüfen, weitere Belege suchen und den Ursprung zurückverfolgen. Reverse Image Search (Bildrückwärtssuche) oder ein Blick auf die Metadaten eines Mediums helfen ebenfalls, Manipulation zu erkennen.

- Resilienz ist wichtiger als Perfektion: Niemand muss oder kann jede Fälschung sofort erkennen. Wichtiger ist, eine gute Überprüfpraxis zu entwickeln, um bei unsicheren Rahmenbedingungen verantwortungsvoll handeln zu können.

Hi shirin! Welche Risiken und Chancen hat der Aufstieg KI-generierter Inhalte für Aktivist*innen und NGOs gebracht – zum Beispiel, wenn es darum geht, Menschenrechtsverletzungen zu dokumentieren?

KI-generierte Inhalte haben die Anforderungen im Umgang mit Medien als Beweismaterial deutlich erhöht. Das größte Risiko besteht nicht nur darin, dass sich ki-generierte Bilder, Audio- oder Videoaufnahmen immer leichter erstellen lassen – sondern auch darin, dass echte Dokumentation schneller in Zweifel gezogen wird. Dieses Phänomen wird oft als „Liar’s Dividend“ bezeichnet: Akteur*innen mit fragwürdigen Absichten nutzen die Existenz solcher Inhalte, um authentische Beweise zu diskreditieren.

Für Aktivist*innen und NGOs bedeutet das, dass Verifikation, Kontext und langfristige Sicherung von Material wichtiger sind denn je. Ein Video allein reicht oft nicht mehr aus – entscheidend sind zusätzliche Informationen darüber, wer es aufgenommen hat, wann und wo es entstanden ist und wie es archiviert wurde.

Gleichzeitig eröffnet KI auch neue Möglichkeiten. Sie kann Menschenrechtsorganisationen dabei unterstützen, große Datenbestände zu strukturieren, Aussagen zu transkribieren und zu übersetzen, Muster von Online-Gewalt zu erkennen oder Inhalte barrierefreier zugänglich zu machen. Auch bei Recherchen kann KI helfen, relevantes Material schneller zu finden.

Letztlich geht es also nicht darum, ob KI „gut“ oder „schlecht“ ist. Entscheidend ist, ob wir Praktiken entwickeln, die dafür sorgen, dass verlässliche Dokumentation auch in einem zunehmend umkämpften Informationsraum Bestand hat.

Welche Formen der Manipulation von Audio- und Videoinhalten begegnen euch bei WITNESS aktuell am häufigsten – worauf sollten Menschen besonders achten?

Die häufigsten Manipulationen sind nicht unbedingt die technisch aufwändigsten. Oft geht es um ältere Aufnahmen, die als aktuell ausgegeben werden, um echtes Material, das mit falschen Angaben zu Ort, Zeit oder Kontext versehen wird, oder um Ausschnitte, die so geschnitten sind, dass entscheidende Informationen fehlen. Viele dieser Veränderungen sind vergleichsweise einfach – sie zielen weniger auf Perfektion als auf schnelle Verbreitung ab.

Gleichzeitig beobachten wir neue Formen KI-gestützter Manipulation, die die Grenzen zwischen authentischen und synthetischen Inhalten weiter verwischen. So werden etwa echte Bilder zu kurzen Videos animiert oder authentisches Material mit künstlich eingefügten Elementen kombiniert. Auch sehr kleine, gezielte Eingriffe können die Aussage eines Bildes oder Videos komplett verändern. Hinzu kommen generative Inhalte, die durch sogenannte „Enhancement“-Techniken erzeugt oder verändert werden. Besonders Audioinhalte geraten zunehmend in den Fokus, da Manipulationen hier oft schwerer zu erkennen sind.

Ein großer Teil des Schadens entsteht jedoch nicht nur durch ausgefeilte Fälschungen, sondern durch das wachsende Misstrauen insgesamt – die Vorstellung, dass alles manipuliert sein könnte.

Das erleichtert es, echte Belege infrage zu stellen, und erschwert es der Öffentlichkeit, verlässliche Informationen zu erkennen. In vielen Fällen sind einfache Methoden wie falsche Beschriftungen oder fehlender Kontext nach wie vor verbreiteter und wirksamer als komplexe KI-Fälschungen. Während spektakuläre Deepfakes viel Aufmerksamkeit bekommen, prägen gerade diese alltäglichen, schnell produzierten und verbreiteten Manipulationen maßgeblich, wie sich Desinformation verbreitet.

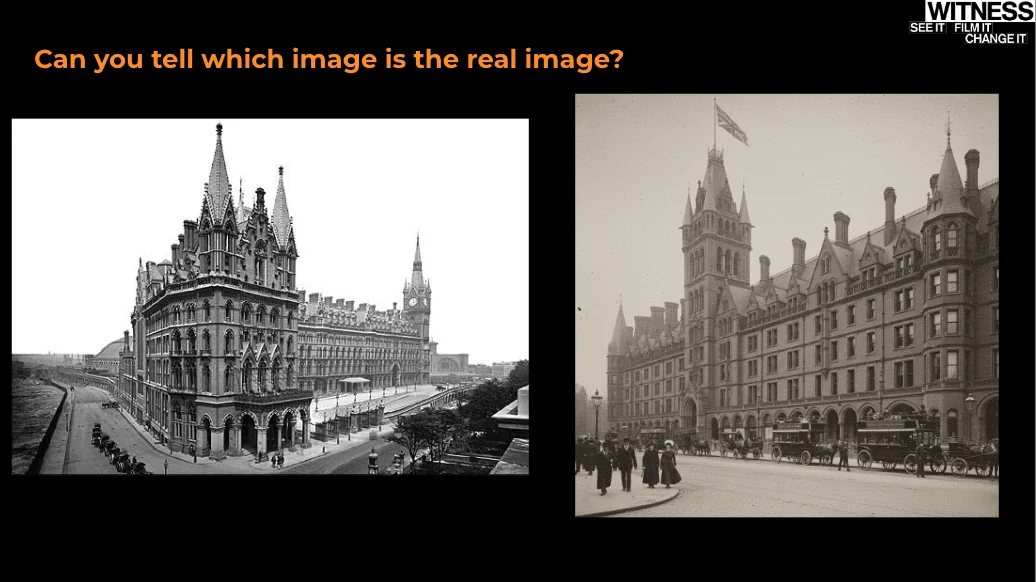

Im Folgenden zeigen wir einige KI-Trends, die wir für das Jahr 2025 identifiziert haben.

Welche einfachen Methoden oder „erste Checks“ können alle nutzen, um einzuschätzen, ob ein Medium manipuliert sein könnte?

Wir empfehlen oft die sogenannte SIFT-Methode – ein einfaches Schema, das dabei hilft, Online-Inhalte schnell zu prüfen, bevor man sie teilt. SIFT steht für: Stop (Innehalten), Investigate the source (Quelle prüfen), Find better coverage (weitere Berichterstattung suchen) und Trace the claim to its original context (zum ursprünglichen Kontext zurückverfolgen).

Stop – Innehalten:

Der erste Schritt ist simpel: kurz innehalten und sich ein paar grundlegende Fragen stellen. Wenn ein Inhalt starke Emotionen auslöst, lohnt es sich, einen Moment zu warten, bevor man reagiert oder ihn weiterverbreitet.

Investigate the source – Quelle prüfen:

Wer hat den Inhalt ursprünglich veröffentlicht? Handelt es sich um den Original-Upload oder um einen Repost von einem unbekannten Account? Welche Inhalte teilt dieser Account sonst – und wirkt er vertrauenswürdig?

Find better coverage – Weitere Quellen suchen:

Wird über das Ereignis auch an anderer Stelle berichtet? Wenn tatsächlich etwas Relevantes passiert ist, gibt es oft weitere Berichte oder Bestätigungen aus anderen Quellen.

Trace the claim – Kontext prüfen:

Versuchen, die ursprüngliche Quelle des Materials zu finden – häufig zeigt sich bei einer kurzen Recherche, dass ein Video bereits Monate oder Jahre zuvor in einem ganz anderen Zusammenhang veröffentlicht wurde.

Auch ein genauer Blick auf das Material selbst kann helfen: Gibt es Unstimmigkeiten wie unnatürliche Lippenbewegungen, abrupte Schnitte, widersprüchliche Spiegelungen, ungewöhnliche Handbewegungen oder unpassende Hintergrundgeräusche? Außerdem sollte man noch prüfen, ob Details wie Wetter, Umgebung, Kleidung, Sprache, Schatten oder Kennzeichen zu den behaupteten Aufnahmebedingungen passen.

Solche ersten Checks sind oft hilfreicher als reine KI-Erkennungstools. Auch wenn sie nicht jede Frage beantworten, fördern sie einen bewussteren Umgang mit Inhalten. Schon ein kurzes Innehalten und das Überprüfen des Kontexts können verhindern, dass irreführende Inhalte weiterverbreitet werden.

Um diesen Prozess zu unterstützen, hat WITNESS für Communitys umfassende Leitfäden zur Verifikation entwickelt.

Gibt es denn Tools oder Ressourcen, die ihr empfehlen könnt, um manipulierte Inhalte zu erkennen – und wie können Einsteiger*innen anfangen, ohne sich überfordert zu fühlen?

Für Einsteiger*innen ist es sinnvoll, zunächst auf einfache Prüfmethoden zu setzen, statt direkt auf sogenannte „Deepfake-Detektoren“, die oft trügerische Sicherheit vermitteln. Ein erster Schritt ist die umgekehrte Bildsuche: Bilder lassen sich in Suchmaschinen wie Google Bilder oder TinEye hochladen, um herauszufinden, ob sie schon einmal online aufgetaucht sind und in welchem Kontext. Auch einzelne Videostandbilder genau anzuschauen kann helfen, Auffälligkeiten oder Schnittfehler zu erkennen. Wenn möglich, lohnt sich außerdem ein Blick auf die Metadaten einer Datei (wenn vorhanden), zum Beispiel Aufnahmezeit, Kamera oder Gerät. Weitere Hinweise ergeben sich, wenn man Ort und Zeitpunkt überprüft: Gebäude, Wetter, Schatten oder Sprache können zeigen, ob ein Bild oder Video tatsächlich zu den angegebenen Bedingungen passt. Hilfreich können zudem frei zugängliche und vertrauenswürdige Investigations-Anleitungen sein, die zeigen, wie man online Inhalte zuverlässig überprüft – ohne dass teure oder komplexe Software nötig ist. Hilfreiche Tools gibt es zwar, doch entscheidender als die Technik ist ein systematisches Vorgehen.

Die wichtigste Botschaft für Einsteiger*innen ist: Niemand muss über Nacht zur forensischen Expert*in werden. Es ist hilfreicher, sich einige verlässliche Routinen anzueignen, als nach dem perfekten Tool zu suchen. Technologien zur Erkennung verändern sich schnell, gute Verifikationsgewohnheiten sind hingegen von Dauer.

WITNESS hat zudem praxisnahe Materialien entwickelt, um Journalist*innen, Aktivist*innen und die Öffentlichkeit im Umgang mit manipulierten Inhalten zu unterstützen – darunter auch der Leitfaden „Dinge, die man vor Benutzung von KI Erkennungs-Tools wissen sollte“, der die Grenzen und Risiken automatisierter Erkennungssysteme aufzeigt. Ergänzend gibt es hilfreiche Schritt-für-Schritt-Anleitungen aus Fact-Checking-Communitys, die zeigen, wie sich Bilder, Videos und Behauptungen im Netz überprüfen lassen.

Wie unterscheiden sich die Herausforderungen durch Desinformation und KI-generierten Inhalten je nach Region oder politischem Kontext?

Ki-generierte Inhalte sind nicht nur ein technisches Problem. Sie stehen oft in Verbindung mit Macht, Vertrauen, Zensur, Ungleichheit und bereits bestehenden Repressionsmustern – ihr Einfluss ist also stark kontextabhängig. Einige Gefahren treten weltweit auf, unabhängig von Kultur oder Region. Ein besonders gravierendes Beispiel ist die Verbreitung nicht-einvernehmlicher intimer Aufnahmen, die zu den häufigsten und schädlichsten Einsätzen von Deepfake-Technologie gehören.

Die Art und Weise, wie synthetische Inhalte eingesetzt werden, hängt oft stark vom politischen und sozialen Umfeld ab. Vor kritischen Momenten wie Wahlen oder Konflikten sehen wir etwa, wie Staaten oder politische Akteure Informationen großflächig manipulieren, um falsche Narrative zu verbreiten. In anderen Kontexten geht es um gezielte Angriffe: Aktivist*innen oder Journalist*innen werden mit erfundenen sexuellen, politischen oder anderen Inhalten diskreditiert.

In stark zensierten Umgebungen verschärft sich das Problem zusätzlich, weil Menschen weniger vertrauenswürdige Quellen haben, um Informationen zu überprüfen – Manipulationen lassen sich dadurch schwerer widerlegen. Auch Sprache spielt eine zentrale Rolle: Viele Systeme zur Moderation oder Erkennung funktionieren in dominanten Sprachen deutlich besser als in unterrepräsentierten. Communitys, die ohnehin marginalisiert sind, sind dadurch oft stärker gefährdet.

Kannst du Beispiele nennen, wie Desinformation oder gefälschte Inhalte die Menschenrechtsarbeit beeinflussen kann?

Desinformation beeinflusst die Menschenrechtsarbeit auf viele Arten. Ein zentraler Effekt ist, dass sie das Umfeld von Beweismaterial „verschmutzt“. In Krisenzeiten sehen sich Investigator*innen oft mit einer Flut von wiederverwendeten, falsch beschrifteten oder KI-generierten Inhalten konfrontiert. Das erschwert es erheblich, schnell zu erkennen, was echt ist, und verlangsamt dringend notwendige Reaktionen. Diese Flut manipulierten Materials kann auch dazu führen, dass Menschen grundsätzlich an allem zweifeln, was den Aufbau von Vertrauen in authentische Beweise deutlich erschwert.

Wir beobachten auch, dass Opfer und Zeug*innen diskreditiert werden. Wenn echtes Filmmaterial von Misshandlungen auftaucht, behaupten Behörden oder feindliche Akteure häufig, dass die Aufnahmen bearbeitet, inszeniert oder KI-generiert seien. Diese Taktik kann Verantwortungsprozesse verzögern und die Öffentlichkeit verwirren.

Desinformation wird zudem zur direkten Einschüchterung genutzt: Aktivist*innen, Journalist*innen und insbesondere Frauen in der Menschenrechtsarbeit werden häufig mit gefälschten sexualisierten Bildern, manipulierten Audioaufnahmen oder koordinierten Diffamierungskampagnen attackiert, um ihre Glaubwürdigkeit zu untergraben und Angst zu erzeugen.

Schließlich kann Desinformation Gemeinschaften spalten. Wenn Menschen Dokumentationen grundsätzlich misstrauen, wird es schwieriger, eine gemeinsame Faktenbasis für kollektives Handeln zu schaffen. Der Schaden entsteht so auch durch Vertrauensverlust, auf den Menschenrechtsarbeit und demokratische Institutionen angewiesen sind.

Welche Best Practices gibt es, damit Fotos, Videos oder Audioaufnahmen als Beweismaterial vertrauenswürdig bleiben?

Ziel ist es, authentisches Material so zu sichern, dass es verteidigt werden kann. Vertrauen entsteht nicht nur durch den Inhalt selbst, sondern auch durch den Prozess, wie die Aufnahmen erstellt, gesichert und geteilt werden. Selbst starkes Beweismaterial kann an Glaubwürdigkeit verlieren, wenn es nicht abgespeichert oder aus dem Kontext gerissen wird. Wichtige Praktiken sind zum Beispiel, das Originalmaterial möglichst immer zu behalten, festzuhalten, wer die Aufnahmen gemacht hat, wann und wo sie entstanden sind und unter welchen Umständen, und unnötige Bearbeitungen zu vermeiden. Wenn eine Bearbeitung nötig ist, sollte immer die uneditierte Originalversion erhalten bleiben.

Es kann außerdem hilfreich sein, zusätzliches Kontextmaterial aufzunehmen – etwa Straßenschilder, markante Gebäude oder kontinuierliche Sequenzen, die Ort und Zeit belegen. Auch relevante Details zu dokumentieren, die später die Glaubwürdigkeit der Aufnahmen stärken können, ist empfehlenswert. WITNESS hat zu diesen Praktiken mehrere hilfreiche Materialien entwickelt, die Journalist*innen und Aktivist*innen bei der sicheren Dokumentation von Beweismitteln unterstützen. Zum Beispiel mit diesem Video Field Guide und diesem Basic Practices-Leitfaden.

Wie trainiert ihr Communitys resilient zu bleiben, auch wenn manipulierte Inhalte nicht immer eindeutig erkennbar sind?

Resilienztraining sollte weniger darauf abzielen, „jede Fälschung zu erkennen“ oder Inhalte strikt in „KI-generiert“ oder „nicht KI-generiert“ einzuteilen. Wichtiger ist, den Menschen zu vermitteln, wie sie unter unsicheren Rahmenbedingungen verantwortungsvoll handeln können. Das bedeutet, praktische Gewohnheiten zu fördern: kurz innehalten, bevor Inhalte geteilt werden, zusätzliche Quellen prüfen, Originaldateien sichern oder hochauflösende Versionen nutzen, den Kontext dokumentieren und sich auf vertrauenswürdige Netzwerke verlassen, um unsichere Inhalte einzuschätzen. Besonders betonen wir dabei kollektive Verifikation anstelle der Verantwortung Einzelner: Communitys sind stärker, wenn sie gemeinsame Abläufe und ein Bewusstsein für den Kontext entwickeln.

Am wichtigsten ist, Vertrauen aufzubauen, ohne falsche Sicherheit zu versprechen. Gute Verifikationsgewohnheiten und verantwortungsbewusste Praktiken beim Teilen von Inhalten können schon einen erheblichen Unterschied machen, auch wenn sich nicht immer jede Manipulation erkennen lässt.

Wie können Menschen kritisch bleiben, ohne in die Falle zu tappen, alles für gefälscht zu halten?

Es ist entscheidend, hier im Gleichgewicht zu bleiben. Unser Ziel ist, dass Menschen einen scharfen Blick entwickeln, aber nicht zynisch werden. Gesunder Skeptizismus bedeutet, nach Belegen, Kontext und Bestätigung zu fragen. Zynismus hingegen geht davon aus, dass nichts echt ist, und gibt die Suche nach Wahrheit auf. Letzteres ist besonders schädlich, weil es genau denen nützt, die wollen, dass es keine Verlässlichkeit mehr gibt.

Eine hilfreiche Faustregel lautet: Nicht fragen „Sind Medien generell vertrauenswürdig?“, sondern „Welche Belege gibt es für diese konkrete Behauptung?“ Dabei sollte man Herkunft, Kontext und Konsistenz prüfen. Manche Inhalte lassen sich nicht zu 100% klären – und das ist in Ordnung. Nicht jedes Medium braucht sofort ein endgültiges Urteil.

Welche Entwicklungen bei KI-generierten Inhalten bereiten euch im Moment die größten Sorgen – und wo seht ihr Hoffnung oder positive Potenziale?

Ich bin besonders besorgt über die Normalisierung des „plausiblen Verleugnens“, bei der mächtige Akteur*innen authentische Beweise immer häufiger als KI generiert abtun. Wir erreichen einen Punkt, an dem fast jeder Inhalt als Fake bezeichnet werden könnte. Dieses ständige Misstrauen untergräbt das öffentliche Vertrauen und erschwert Verantwortlichkeit.

Technologisch macht mir vor allem die Kombination aus drei Entwicklungen Sorge: Inhalte lassen sich einfacher erstellen, schneller verbreiten und gezielter auf Personen, Communitys, Sprachen oder politische Situationen zuschneiden. Das erhöht die Risiken bei Wahlen, Konflikten, Belästigung, Betrug und der Diskreditierung von Zeug*innen erheblich.

Gleichzeitig sehe ich auch Hoffnung: Wir stehen an einem Punkt, an dem wir die Richtung dieser Technologien noch gestalten können. Das öffentliche Bewusstsein wächst, die Zusammenarbeit zwischen Technik und Zivilgesellschaft wird stärker, und die Bedeutung von Herkunft, Sicherung und Medienkompetenz für vertrauenswürdiges Material wird zunehmend anerkannt. Entscheidungen zu Standards, Schutzmaßnahmen und Verantwortlichkeit werden maßgeblich bestimmen, wie diese Technologien die Gesellschaft in Zukunft beeinflussen.

Wir bedanken uns für das Interview.

Wer noch stärker in das Thema einsteigen möchte, findet weitere Informationen zur KI-Arbeit von WITNESS unter https://www.gen-ai.witness.org/